Mensch vs. Maschine – wer kontrolliert wen?

Von Daniela Gjuraj

Schon wieder nicht zum Bewerbungsgespräch bei einer Firma eingeladen worden und frustriert darüber, woran es diesmal gelegen haben könnte? Keine Sorge, nimm es nicht persönlich. Es wird immer schwieriger herauszufinden, welche Entscheidungen bereits automatisiert von Bewerbungs-Algorithmen und welche noch von Menschenhand getroffen wurden. Der Mensch hat den Algorithmus ja genau dafür geschaffen: um lästige Entscheidungen und Aufgaben an ihn abgeben zu können und um einen technischen Freund und Helfer zu haben. Die Konstellation „Mensch programmiert -> Maschine macht“, scheint jedoch immer mehr aus dem Ruder zu laufen; Maschinen lernen zunehmend selbst und treffen basierend auf Lerndaten immer mehr eigene Entscheidungen. Völlig unabhängig von der Programmierung. Da stell sich die Frage: Steuern wir den Algorithmus oder steuert er uns?

Wieso haben Algorithmen überhaupt eine Macht?

Stephen Hawking sprach davon, dass KI die Menschheit auslöschen könnte. Auch Elon Musk ist der Meinung, dass KI eine der größten Bedrohungen der Menschheit darstellt und wir uns damit quasi einen Dämon herangezüchtet haben. Was passiert, wenn die KI so weit entwickelt ist, dass die Hollywood-Dystopien wahr werden? Dass Maschinen alles können, was Menschen können, nur eben tausend Mal besser und das gegen uns verwenden? Niemand weiß, ob die Superintelligenz uns gegenüber wohlwollend gesinnt sein wird oder so viel Kontrolle und Macht erlangt, dass sie uns unterwerfen könnte.

Doch genug von pessimistischen Horrorszenarien und Teufel-an-die-Wand-Malereien. Fest steht, dass ADM (Automatic Decision Making), also algorithmisch bzw. durch KI gesteuerte Entscheidungsprozesse, eine wichtige Rolle bei unglaublich vielen Auswahlverfahren spielen – egal ob es dabei um Personal, Kreditvergabe oder Versicherungen geht. Jedoch können selbst Programmierende von KI-Anwendungen nicht nachvollziehen, wie eine KI bzw. ein Algorithmus Daten verarbeitet, um zu einem bestimmten Ergebnis zu kommen. Man spricht vom Black Box Phänomen – Daten gehen ein, werden in einer Black Box auf unbekanntem Weg verarbeitet und kommen als Resultat wieder heraus. Ab einem gewissen Punkt werden Algorithmen auch nicht mehr programmiert. Sie lernen von da an selbst, mit Unmengen von Daten, die sie in einer Black Box verarbeiten.

Quelle: Jonathan Brady on picturealliance/ empics

Wir können den Algorithmus also programmieren und ihn darauf trimmen, ab einer gewissen Datenmenge selbst zu lernen. Wie er aber arbeitet, können wir nicht kontrollieren – lediglich die Grundsätze und Daten, anhand derer der Algorithmus entscheidet, sind kontrollierbar. Der Algorithmus kann also oft nicht neutral entscheiden, sondern immer nur basierend auf dem, was ihm durch die Lerndaten eingespeist wurde.

Wo ist algorithmische Macht relevant?

Die NGO Algorithm Watch ist der Meinung, dass „Prozesse algorithmischer Entscheidungsfindung nachvollziehbar sein (müssen), damit sie demokratischer Kontrolle unterworfen werden können. Demokratische Gesellschaften haben die Pflicht, diese Nachvollziehbarkeit herzustellen: durch eine Kombination aus Technologien, Regulierung und geeigneten Aufsichtsinstitutionen“. Das ist besonders dann extrem wichtig, wenn KI die Entscheidungsmacht hat – Beispielsweise wenn es um Einladungen zu Vorstellungsgesprächen geht oder darum, wer einen Kredit bekommt. Aufgrund ihrer Beispieldatensätze, die von der Welt, in der wir leben abgeleitet sind, neigt KI dazu, dementsprechend auch unsere Lebensrealität zu reproduzieren – und so kommt es auf dem Arbeitsmarkt z. B. durch algorithmische Prozesse dazu, dass sich die KI tendenziell eher für einen Mann als eine Frau entscheidet, weil die KI über die Datensätze aus der „echten Welt“ patriarchische Bias/ Voreingenommenheiten aufgenommen hat.

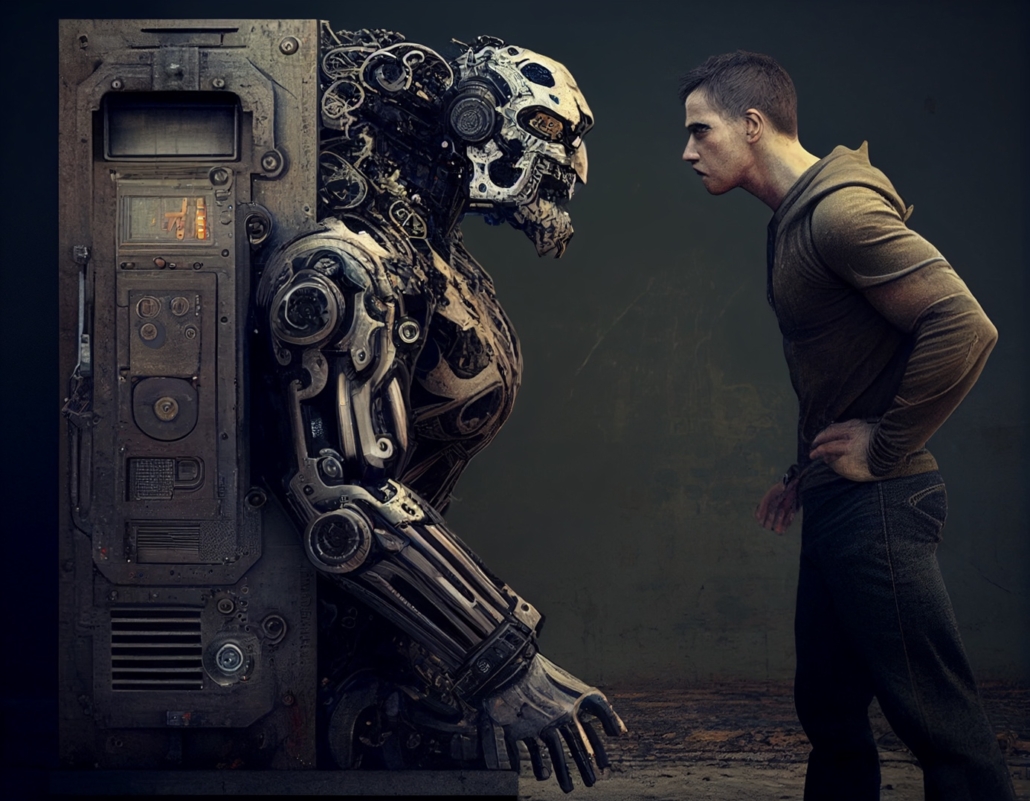

Quelle: Erstellt von Daniela Gjuraj mit dem KI-Bildgenerierungstool midjourney.com

Weiterhin basieren Berechnungen von Bewertungen auf Scoring, was man z. B. aus dem Kreditbereich kennt. Hierbei soll der Algorithmus auf Basis von, in der Vergangenheit gesammelten Erfahrungen, eine Prognose für die Zukunft erstellen. Hierbei weiß jedoch niemand, welche Daten genau der Algorithmus hierfür in Betracht zieht. Algorithmen unterliegen der Geheimhaltung. Was Entwicklende mit Geschäftsgeheimnissen und potenzieller Manipulation begründen. Fast täglich häufen sich Berichte über gravierende Fälle diskriminierender oder fehlerhafter Entscheidungen von Maschinen an. Auch Entscheidungssysteme, die eine Vielzahl an personenbezogenen Daten mit maschinellem Lernen verarbeiten, haben ein ungemeines Missbrauchspotential: so können uns Google, Amazon etc. mit der Unzahl an Daten, die sie über uns besitzen, zu Werbezwecken oder für politische Manipulation nutzen. Geschäftsgeheimnisse und private Verfügungsgewalt steht einer Transparenz und Offenlegung der Algorithmen entgegen.

Die Wissenschaftlichen Dienste des Bundestages gehen davon aus, dass in Zukunft nicht nur komplexe Algorithmen in den Bereichen Wirtschaft und Finanzen angewandt werden, sondern sich dieser Bereich auf Recht, Gesundheit und Sicherheit oder der öffentliche Verwaltung ausweiten wird.

Was kann man tun?

Algorithmenanalyse (Auditing) und Überprüfung, sollen Transparenz herstellen. Dabei soll die Zweckmäßigkeit und Angemessenheit des Einsatzes der algorithmischen Systeme geprüft werden. Weiterhin ist sicherzustellen, dass Teilhabegerechtigkeit und Diversität weiterhin gewährleistet werden und Fehler vermeidbar und korrigierbar bleiben.

Erstellt von Daniela Gjuraj mit dem KI-Bildgenerierungstool midjourney.com

Prof. Dr. Anna Zweig, Mitgründerin der NGO Algorithm Watch, schlug bereits schon in der Vergangenheit, zusammen mit der Philosophin Lorena Jaume-Palasí, dem Journalisten Lorenz Matzat und Matthias Spielkamp vor, eine Art Algorithmen-TÜV zu implementieren. Hierbei soll ein Team mit Expertise, die Codes prüfen und für gut oder schlecht befinden. So könnten vertrauenswürdige Rechenverfahren schließlich ein Siegel bekommen und die Kundschaft wüsste, dass es nichts zu befürchten gibt.

Hier könnte zum Beispiel das System-Design überprüft werden. Dabei wird in Abhängigkeit einer bestimmten Fragestellung, die Datenbasis eines Systems überprüft. Komplexe Algorithmen können auf diese Weise leider jedoch kaum überprüft werden. Hier muss man auf eine andere Methode zurückgreifen – die Input-Output-Analyse. Die Daten, die in das System fließen, werden mit den Resultaten, die daraus entstehen, systematisch verglichen. Jedoch ist auch hier das Problem, das nicht der Algorithmus an sich, sondern die Daten, die darin eingebunden werden, untersucht werden. Gerade europäische Datenschutzgesetzte oder Urheberrechtsfragen stellen sich hier oft in den Weg. Es geht also nicht nur um Algorithmen, sondern auch um die Kontrolle der Daten und den Zugriff auf Daten. Andererseits sind Datenschutzgesetze hier natürlich auch behilflich, denn sie geben Auskunft darüber, welche Daten zu welchem Zweck verwendet werden dürfen.

Algorithmen, Daten, KI und maschinelles Lernen sind Mechanismen, die uns noch lange in der Zukunft begleiten werden und unser Leben in vielen Ebenen weiter beeinflussen werden. Sei es im Zuge der Digitalisierung oder Vereinfachung von Arbeitsprozessen. Sie bergen ein ganz neues, risikoreiches und spannendes Experiment mit der Gesellschaft, für das jetzt die Weichen gestellt werden müssen – jetzt, wo Kontrolle noch ausübbar ist und jetzt, wo sich der Algorithmus noch nicht so weit verselbständigt hat, als dass er die Macht über uns bekommt.

Quellen:

https://www.bertelsmann-stiftung.de/fileadmin/files/BSt/Publikationen/GrauePublikationen/ADM_Fallstudien.pdf

https://www.kas.de/de/analysen-und-argumente/detail/-/content/algorithmische-entscheidungen-transparenz-und-kontrolle

https://www.boell.de/de/2018/01/30/wer-steuert-die-kuenstliche-intelligenz

https://www.it-zoom.de/it-director/e/die-macht-von-algorithmen-kontrollieren-16200/